Les informations fausses et trompeuses alimentées par une intelligence artificielle innovante, qui menacent d’éroder la démocratie et de polariser la société, constituent le principal risque immédiat pour l’économie mondiale, a déclaré mercredi le Forum économique mondial dans un rapport.

Dans son dernier rapport sur les risques mondiaux, l’organisation ajoute qu’un ensemble de risques environnementaux figurent parmi les plus grandes menaces à long terme. Le rapport a été publié avant le rassemblement annuel des PDG et des dirigeants mondiaux dans la station de ski suisse de Davos et est basé sur une enquête menée auprès de près de 1 500 experts, dirigeants de l’industrie et décideurs politiques.

Le rapport classe les fake news et la désinformation comme le risque le plus grave au cours des deux prochaines années, soulignant à quel point les progrès technologiques rapides créent également de nouveaux problèmes ou aggravent ceux qui existent déjà.

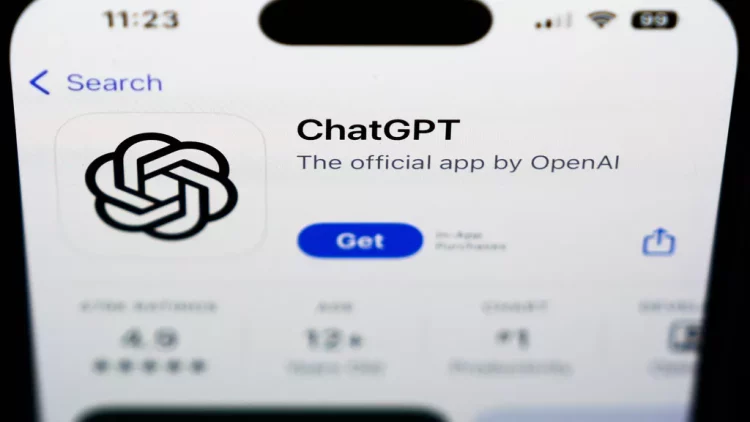

Les auteurs craignent que l’essor des chatbots génératifs d’IA comme ChatGPT signifie que la création de contenu synthétique sophistiqué pouvant être utilisé pour manipuler des groupes de personnes ne sera plus limitée aux personnes possédant des compétences spécialisées.

L’IA devrait être un sujet brûlant la semaine prochaine lors des réunions de Davos, auxquelles devraient participer des chefs d’entreprises technologiques, dont le PDG d’OpenAI, Sam Altman, le PDG de Microsoft, Satya Nadella, et des acteurs de l’industrie de l’IA comme le scientifique en chef de l’IA de Meta, Yann LeCun.

Les fake news et la désinformation alimentées par l’IA apparaissent comme un risque au moment même où des milliards de personnes dans un grand nombre de pays, y compris de grandes économies comme les États-Unis, la Grande-Bretagne, l’Indonésie, l’Inde, le Mexique et le Pakistan, se rendent aux urnes cette année.

“Vous pouvez exploiter l’IA pour réaliser des deepfakes et avoir un impact réel sur de grands groupes, ce qui alimente réellement la désinformation”, a déclaré Carolina Klint, responsable de la gestion des risques chez Marsh, dont la société mère Marsh McLennan a co-écrit le rapport avec Zurich Insurance Group.

“Les sociétés pourraient devenir encore plus polarisées” à mesure que les gens auront plus de mal à vérifier les faits, a-t-elle déclaré. De fausses informations pourraient également être utilisées pour alimenter les questions sur la légitimité des gouvernements élus, “ce qui signifie que les processus démocratiques pourraient être érodés, et cela entraînerait également une polarisation sociétale encore plus grande”, a déclaré Klint.

L’essor de l’IA entraîne une foule d’autres risques, a-t-elle déclaré. Il peut responsabiliser les “acteurs malveillants” en facilitant la réalisation de cyberattaques, par exemple en automatisant les tentatives de phishing ou en créant des logiciels malveillants avancés. Avec l’IA, “vous n’avez pas besoin d’être l’outil le plus pointu du hangar pour être un acteur malveillant”, a déclaré Klint.

Cela peut même empoisonner les données récupérées sur Internet pour entraîner d’autres systèmes d’IA, ce qui est “incroyablement difficile à inverser” et pourrait entraîner l’intégration de biais supplémentaires dans les modèles d’IA, a-t-elle déclaré.

L’autre grande préoccupation mondiale des répondants à l’enquête sur les risques concernait le changement climatique. Après la désinformation et la mésinformation, les conditions météorologiques extrêmes constituent le deuxième risque le plus urgent à court terme.

À long terme – défini sur dix ans – les conditions météorologiques extrêmes ont été décrites comme la menace n°1, suivie par quatre autres risques liés à l’environnement : changement critique des systèmes terrestres ; perte de biodiversité et effondrement des écosystèmes; et les pénuries de ressources naturelles.

“Nous pourrions être poussés au-delà du point de basculement irréversible du changement climatique” au cours de la prochaine décennie, alors que les systèmes terrestres subissent des changements à long terme, a déclaré Klint. AFP

Abonnez-vous à notre chaine

Abonnez-vous à notre chaine